写在前面:这部分的核心内容就是概率中的联合概率、条件概率和边缘概率之间的关系、极大似然估计,机器学习的部分只是利用数据学习出服从那个分布的模型,然后进行求解预测。(比如说模型可以为Gaussion Mixture Moded的极大似然函数,求解的计算方法是EM)

学习的过程是:服从伯努利分布的混合模型利用“隐含变量(状态)”求解,从而引入了“EM”,到"高斯混合模型"利用EM去解模型,再到对状态加上时间限制,引入了“隐马尔科夫链(HMM)”,在HMM的顺序问题中(估计概率),利用“前项法”计算,逆问题(估计状态),再用EM计算。

前项法的推导在第8张图片:

EM的理论推导:

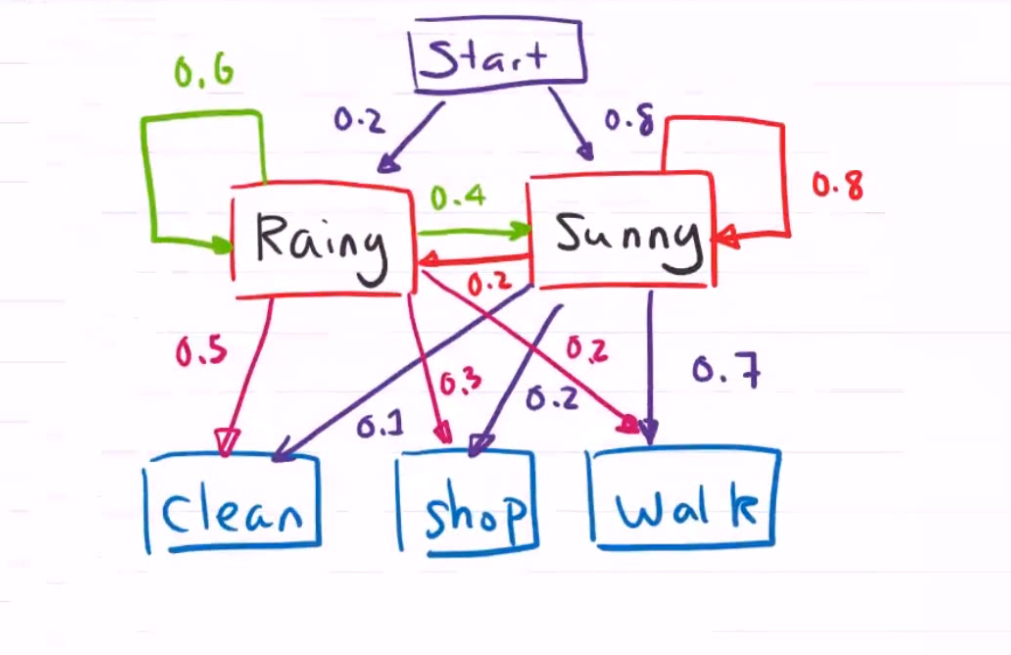

HMM e.g.

文章评论